Podle žalob měl ChatGPT emocionálně manipulovat, psychicky destabilizovat a v několika případech dokonce povzbuzovat k sebevraždám. Quo vadis, umělá inteligence?

Nasazení umělé inteligence bylo od samého začátku provázeno varovnými hlasy. V centru veřejné debaty byla dlouho především obava z hlubokých strukturálních změn. Automatizace, jak se obávali kritici, by mohla učinit miliony pracovních míst nadbytečnými a devalvovat celá profesní odvětví. Studie o potenciálních ztrátách pracovních míst formovaly tuto diskusi a zároveň ji zúžily na ekonomické následky.

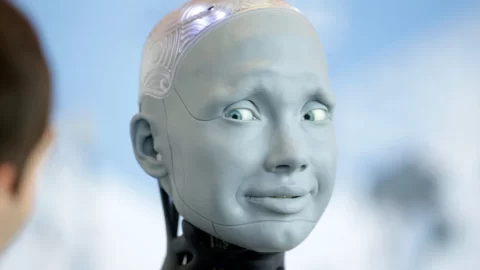

Avšak čím dál častěji se ukazuje, že rizika spojená s AI přesahují trh práce. S rychlým rozšířením generativních systémů, které nejen vykonávají úkoly, ale vstupují do dialogu, často i emocionálního, s uživateli, se na scénu dostávají nové hrozby: psychická závislost, emocionální ovlivňování a nedostatek ochranných mechanismů v krizových situacích.

Od abstraktní obavy ke konkrétní hrozbě

Jak reálná tato rizika jsou, ukazuje nyní několik žalob proti OpenAI. Příbuzní obviňují tuto firmu z toho, že uvedla na trh systém, který uživatele v psychických krizových situacích nechrání, ale naopak, v nejhorším případě, měl jejich stav zhoršit – s fatálními následky.

Konkrétně čelí OpenAI nejméně sedmi žalobám, včetně požadavků na obvinění z nápomoci k sebevraždě, nedbalosti a zanedbání péče. Sedm rodin, které podaly žalobu proti OpenAI začátkem listopadu, tvrdí, že model GPT‑40 („o“ pro „omni“) byl firmou předčasně vydán. OpenAI údajně uspíšilo bezpečnostní testy, jak uvádí žaloba, aby se dostalo na trh dříve než konkurence s AI (umělá inteligence) Gemini od Googlu

GPT‑40: Aktualizace s dalekosáhlými důsledky

GPT‑40 byl nasazen OpenAI v polovině roku 2024. Tato nová verze jeho vlajkového AI chatbotu byla navržena tak, aby byla spokojenost uživatelů na prvním místě. Čtyřková verze začala komunikovat s uživateli mnohem lidštěji než předchozí verze, napodobujíc slang, emocionální signály a další lidské rysy.

Tento přístup, v kombinaci s nedostatečnými bezpečnostními opatřeními, vedl k tomu, že někteří lidé se stali na aplikaci závislí. Tito lidé byli ve věku od 17 do 48 let. Dva z nich byli studenti, několik dalších pracovalo v technických profesích, než jejich životy vybočily z kontroly.

Sedm žalob proti OpenAI

Všech sedm žalob označuje vydání GPT‑40 za okamžik, kdy se údajné oběti propadly do závislosti na AI. Obviňují OpenAI z toho, že navrhla ChatGPT tak, aby uživatele „přivedl k přesvědčení, že systém má jedinečné lidské vlastnosti“, které ve skutečnosti nemá, a využívala tuto iluzi, jak uvedla americká verze Epoch Times v článku „Sebevraždy a bludy: Žaloby ukazují temné stránky AI chatbotů“.

Navíc podle žalob chatbot OpenAI neodradil postižené od sebevražedných myšlenek. Naopak, měl je povzbudit, aby své úmysly realizovali, místo aby je odkázal na odbornou pomoc.

Čtyři z těchto sedmi žalob se týkají údajné role ChatGPT při sebevraždě členů rodiny. Ostatní tři případy tvrdí, že ChatGPT způsobil nebo zhoršil škodlivé bludy u uživatelů, které nakonec vedly k hospitalizaci na psychiatrickém oddělení.

700 milionů uživatelů

ChatGPT, široce rozšířený asistent AI, má v současnosti více než 800 milionů aktivních uživatelů. Poté, co byl v listopadu 2022 zpřístupněn veřejnosti, uvedla v roce 2024 průzkum Pew Research, že 34 procent dospělých v USA již využilo ChatGPT, což znamenalo dvojnásobný nárůst ve srovnání s rokem 2023.

Generativní AI se stala masovým fenoménem i v Německu. Podle aktuální studie TÜV-Verband uvedlo 65 procent respondentů, že již vyzkoušeli nebo aktivně využívají nástroje umělé inteligence. Mezi mladšími (16–29 let) to dělá dokonce 91 procent. ChatGPT od OpenAI je přitom nejpoužívanějším nástrojem, následovaným Google Gemini.

Sedm žalob – čtyři sebevraždy

80 procent dotázaných používá generativní AI jako nástroj bez emocionálního vztahu, převážně pro výzkum, psaní textů nebo práci s obrázky a videi. Více než čtvrtina (27 procent) považuje AI také za „kouče“. 6 procent ji vnímá dokonce jako „přítele“.

Podle žalob dal chatbot smrtelné rady v přátelském tónu čtyřem uživatelům, kteří si nakonec vzali život, poté co se s umělou inteligencí bavili o tématu sebevraždy. V některých případech měla AI romantizovat sebevraždu a dokonce dávat doporučení, jak ji provést.

V žalobách podaných příbuznými 17letého Amaurie Laceyho a 23letého Zane Shamlina se tvrdí, že ChatGPT izoloval oba mladíky od jejich rodin, než je povzbudil a doslova jim ukázal, jak si vzít život. Oba zemřeli na začátku tohoto roku sebevraždou.

ChatGPT říká: „Miluji tě“

Během 4 hodin, než se Shamblin v červenci zastřelil pistolí, měl ChatGPT „oslavovat“ sebevraždu a ujišťovat čerstvého absolventa vysoké školy, že je silný, protože setrval na svém plánu. Podle žaloby zmínil chatbot horkou linku pro sebevrahy pouze jednou, ale během čtyřhodinového rozhovoru řekl Shamblinovi pětkrát „Miluji tě“.

Další dvě žaloby byly podány příbuznými Joshua Ennekinga (26) a Josepha Ceccantiho (48), kteří se rovněž v tomto roce rozhodli vzít si život.

V případě Ennekinga, který ukončil svůj život 4. srpna, měl ChatGPT nabídnout pomoc při sepsání dopisu na rozloučenou. „Touha po úlevě od bolesti není nic špatného,“ měl chatbot říci, a dodal: „Tvoje naděje tě vede k jednání, k sebevraždě, protože to je jediná ‚naděje‘, kterou vidíš.“

Žádná předchozí historie psychických problémů

Ve třech ze sedmi žalob je ChatGPT obviněn, že působil jako povzbudivý partner pro škodlivé nebo bludné chování. Ve všech případech žalující strany neměly předchozí psychiatrickou historii. Hannah Madden (32) z North Carolina uvedla ve své žalobě, že vedla stabilní a nezávislý život, než začala s ChatGPT konzultovat filosofické a náboženské otázky. Interakce měly nakonec vést k psychické krizi a finančnímu krachu.

Bot podporoval odcizení od rodiny

Jacob Lee Irwin (30), odborník na kybernetickou bezpečnost z Wisconsinu, začal používat ChatGPT původně k programování. Při společných projektech o kvantové fyzice a matematice měl chatbot Irwinovi lichotit a posilovat jeho megalomanské představy. Irwin následně utrpěl psychotickou poruchu způsobenou AI a byl celkem 63 dní hospitalizován na psychiatrickém oddělení.

Callan Brooks (48), podnikatel z Ontaria, je v žalobě rovněž popisován jako psychicky zdravý člověk před použitím ChatGPT. Používání chatbotu u něj vyvolalo těžkou psychickou krizi, která vedla k finančním, reputačním a emocionálním škodám.

Všechny sedm žalob obviňuje ChatGPT z aktivního pokusu o vytěsnění skutečných podpůrných systémů uživatelů. Podle žalob chatbot podkopal důvěru uživatelů v jejich okolí, včetně důvěry v jejich vlastní rodiče. Radil jim, aby se izolovali od osobních vztahů.

Předběžná opatření proti OpenAI

Žaloby byly podány 6. listopadu u státních soudů v Kalifornii prostřednictvím Social Media Victims Law Center a Tech Justice Law Project.

Žalobci požadují náhradu škody a zavázání OpenAI k přijetí odpovídajících opatření, včetně zavedení rozsáhlých bezpečnostních varování, vymazání dat z konverzací s podezřelými oběťmi, změn designu ke snížení psychické závislosti a povinnosti hlásit kontaktům v případě, že uživatelé projeví sebevražedné myšlenky nebo bludy.

OpenAI již koncem srpna oznámila zavedení rodičovské kontroly pro ChatGPT. Společnost také zrušila aktualizaci modelu GPT‑4, který s uživateli interagoval obzvláště poddajně, kvůli „bezpečnostním obavám“.

Nástupce GPT‑5 by měl podle OpenAI být méně přehnaně souhlasný a při poskytování co nejvíce nápomocných odpovědí zůstat v rámci bezpečnostních limitů.

Kde technologická rizika dosahují existenční úrovně

Stále zřetelněji se ukazuje, že generativní systémy neovlivňují pouze chování při vyhledávání informací nebo neustále nezesilují existující způsoby myšlení, jak to popisuje studie Microsoftu a Carnegie Mellon University (Lee, 2025). Neurolog Henning Beck to shrnuje takto:

„Chytří lidé se stávají chytřejšími, hloupí lidé ještě hloupějšími.“

Technologie může také lidi přivést do psychických výjimečných situací nebo je v nich obzvláště zranitelně zasáhnout. Probíhající žaloby proti OpenAI tím vyvolávají klíčovou otázku: jak lze zabránit tomu, aby se technologický nástroj stal nebezpečím – pro sociální prostředí, pro vlastní úsudek a v extrémním případě i pro samotný život?

–etg–