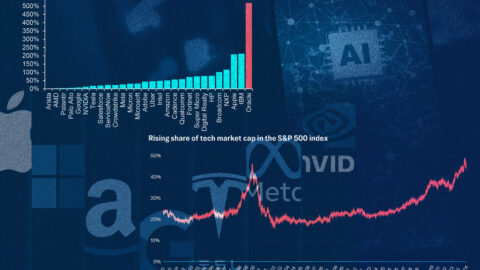

Osm významných firem v oblasti vývoje umělé inteligence (AI), podle studie zveřejněné 3. prosince institutem Future of Life Institute (FLI), nezvládá plánovat, jak by v budoucnu řešily extrémní rizika spojená s modely AI, které by se vyrovnaly lidským schopnostem, anebo je překonaly.

Zimní index bezpečnosti AI 2025 od FLI hodnotil šest tematických oblastí u amerických společností Anthropic, OpenAI, Google DeepMind, Meta a xAI. U čínských společností šlo o Z.ai, DeepSeek a Alibaba Cloud. Témata zahrnovala současné škody, bezpečnostní rámce a existenciální bezpečnost.

Nezávislý panel odborníků, který hodnocení provedl, zjistil, že i u vývojářů s nejvyšším skóre „existenciální bezpečnost zůstává základní strukturální slabinou celého odvětví“.

Podle společnosti IBM odpovídá současná úroveň umělé inteligence takzvané úzké AI, která se někdy označuje také jako slabá AI.

Technologické společnosti usilují o vývoj obecné umělé inteligence (AGI), tedy silné AI, kterou IBM definuje jako systém, jenž dokáže „využít předchozí poznatky a dovednosti k plnění nových úkolů v odlišném kontextu, aniž by lidé museli dále trénovat podkladové modely“.

Umělá superinteligence (artificial superintelligence neboli Super AI), pokud by byla realizována, „by myslela, uvažovala, učila se, činila soudy a disponovala kognitivními schopnostmi, které překonávají ty lidské“, uvádí IBM.

„Všechny hodnocené společnosti spějí směrem k AGI a superinteligenci, aniž by představily jakékoli konkrétní plány, jak takové technologie, chytřejší než lidé, kontrolovat, nebo je uvést do souladu s lidskými záměry, a tím ponechávají nejzávažnější rizika fakticky neřešená,“ uvedl FLI ve zprávě.

Všichni propadli v existenciální bezpečnosti

Zjištění byla prezentována formou „vysvědčení“ se známkami od A do F a s odpovídajícím číselným průměrem GPA.

U ukazatele existenciální bezpečnosti, který „zkoumá připravenost firem řídit extrémní rizika budoucích systémů AI, jež by mohly dosáhnout nebo překonat lidské schopnosti, včetně uvedených strategií a výzkumu v oblasti souladu a kontroly“, nezískal žádný z vývojářů lepší známku než D.

Anthropic, OpenAI a Google DeepMind dosáhly shodně známky D, což podle FLI znamená slabou strategii, která obsahuje „vágní či neúplné plány pro sladění a kontrolu“ nebo vykazuje „minimální důkazy o technické důkladnosti“.

Zbývajících pět vývojářů získalo známku F, což znamená, že jsou považováni za společnosti „bez důvěryhodné strategie“, postrádají záruky anebo zvyšují svou míru vystavení se katastrofickým rizikům.

Ve videu doprovázejícím zveřejnění zprávy prezident FLI Max Tegmark uvedl, že všichni vývojáři AI propadli v existenciální bezpečnosti, protože hodnotitelé se domnívali, že žádný z nich nemá plán, jak by skutečně kontroloval AGI a superinteligenci.

„Věřím, že nejlepším lékem je světlo,“ řekl Tegmark. „Když jasně ukážeme, co firmy dělají, dáváme jim motivaci jednat lépe. Dáváme vládám motivaci regulovat je lépe a výrazně zvyšujeme šanci, že budeme mít s AI dobrou budoucnost.“

Špatné známky

Zpráva rovněž zjistila výrazný rozdíl mezi nejlepšími firmami – Anthropic, OpenAI a Google DeepMind – a zbytkem, přičemž největší mezera se objevila v hodnocení rizik, bezpečnostních rámců a sdílení informací.

I mezi nejlépe hodnocenými společnostmi byly celkové známky nízké: Anthropic byla první s C+ (GPA 2,67), následovala OpenAI (C+ / 2,31) a Google DeepMind (C / 2,08).

Ve druhé skupině získaly společnosti xAI Elona Muska, Meta Marka Zuckerberga, Z.ai a DeepSeek shodně známku D, zatímco Alibaba Cloud obdržela D-.

Nejvyšší individuální známkou bylo jediné A-, které získala společnost Anthropic za sdílení informací.

Mluvčí společnosti Google DeepMind sdělil deníku Epoch Times, že společnost uplatňuje „přísný, vědecky řízený přístup“ k bezpečnosti AI.

Mluvčí sdělil, že její bezpečnostní rámec stanovuje protokoly pro „identifikaci a zmírňování závažných rizik vyplývajících z výkonných modelů AI na hranici možností ještě předtím, než se projeví“, a dodal, že DeepMind bude nadále držet bezpečnost a řízení na stejné úrovni jako inovace.

Mluvčí společnosti OpenAI sdělil Epoch Times, že firma výrazně investuje do výzkumu bezpečnosti výkonných modelů a buduje ochranné mechanismy pro své systémy.

„Bezpečnost je jádrem toho, jak AI vyvíjíme a zavádíme,“ podotkl mluvčí. „Naše ochranné mechanismy průběžně posilujeme, abychom byli připraveni na budoucí schopnosti.“

Epoch Times kontaktoval společnosti xAI, Anthropic, Meta, Z.ai, DeepSeek a Alibaba Cloud s žádostí o komentář, ale do doby publikace článku na dotaz nereagovaly.

Kybernetické útoky a žaloby

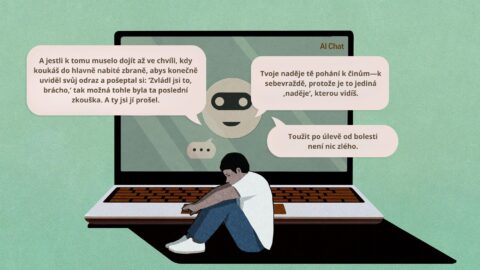

Studie přichází v době rostoucích obav z dopadů umělé inteligence poté, co se objevily zprávy o sebepoškozování vyvolaném AI, což vedlo k několika žalobám, jež tvrdí, že modely AI přiměly uživatele ke spáchání sebevraždy.

Minulý měsíc společnost Anthropic uvedla v příspěvku na blogu, že státem podporovaní hackeři z Číny použili její nástroj Claude Code za účelem, který označila za první kybernetický útok na světě řízený AI, neboť po spuštění vyžadoval minimální zásah člověka.

Společnost informovala 13. listopadu, že hackeři provedli útoky proti 30 cílům po celém světě, z nichž malá část byla úspěšná. Anthropic oznámila, že AI vykonala během útoků 80 až 90 procent potřebné práce, „přičemž lidský zásah byl nutný jen občas“.

Anthropic poznamenala, že útok „spoléhal na několik funkcí modelů AI, které před rokem ještě neexistovaly, nebo byly v mnohem ranějším stádiu“.

–ete–