AI společníci mohou působit lákavě, ale připomínají spíš video s hořícím ohněm ukazované promrzlému člověku než skutečné zápalky a dřevo.

Vědeckofantastické filmy jako Ona nebo Robot & Frank nás na příchod AI přátel připravovaly už dávno – a tato fikce se nyní stává realitou. V nedávném podcastu Mark Zuckerberg prohlásil, že Američané zoufale potřebují více sociálních kontaktů – a že by tuto potřebu mohli naplnit roboti.

AI společníci jsou navrženi tak, aby působili jako utěšitelé, měli neochvějnou trpělivost a neměli vlastní potřeby. „Nelze ale jednoduše říct, že chatbot jako společník vyřeší epidemii osamělosti,“ uvedla pro Epoch Times výzkumnice z Princetonské univerzity Rose Guingrichová. Naopak – AI nástroje mohou narušovat právě ty sociální dovednosti, které mají údajně posilovat.

Zaslíbený lék Silicon Valley

Téměř polovina Američanů má tři nebo méně blízkých přátel. Odpovědí technologického sektoru na problém lidské osamělosti jsou AI společníci – digitální přátelé, terapeuti nebo dokonce romantičtí partneři, kteří jsou naprogramováni tak, aby simulovali rozhovor, empatii a porozumění. Na rozdíl od neohrabaných chatbotů z minulých let jsou dnešní sofistikované systémy postaveny na velkých jazykových modelech, které vedou zdánlivě přirozený dialog, sledují vaše preference a reagují s domnělou emoční inteligencí.

První způsoby využívání odhalují, proč se o AI „společníky“ zvyšuje zájem. Podle průzkumu laboratoře MIT Media Lab z roku 2024 většina uživatelů zapojuje tyto systémy ze zvědavosti nebo pro zábavu. Dvanáct procent respondentů však uvedlo, že hledají úlevu od pocitu osamění, a čtrnáct procent chtělo mluvit o osobních záležitostech, které by se jim obtížně sdílely s jinými lidmi.

„Někdy se cítím osaměle a chci být jen sám,“ napsal jeden z uživatelů. „V takové chvíli si rád povídám se svým AI společníkem, protože se cítím v bezpečí a nikdo mě nebude soudit za špatná rozhodnutí, která jsem udělal.“

Jiní uživatelé mají spíše každodenní důvody – povídají si s chatboty kvůli nápadům na večeři nebo jako inspiraci pro psaní.

Kelly Merrill, odborný asistent v oblasti komunikace o zdraví a technologiích a výzkumník v oblasti interakcí s AI, uvedl příklad starší ženy ze své komunity, která začala umělou inteligenci využívat k základním věcem. Například: „Mám v lednici těchto šest surovin. Co z toho dnes můžu uvařit?“ „Byla naprosto ohromená,“ řekl Merrill pro Epoch Times.

Přínosy tu nepochybně jsou, dodal, ale rozhodně to není jen růžové.

Když služba oslabuje

Zásadní omezení vztahů s umělou inteligencí spočívá v jejich podstatě: simulují lidské emoce, které však skutečně neprožívají.

Když vám společník s umělou inteligencí projeví účast nad špatným dnem, provádí pouze statistickou analýzu jazykových vzorců, aby určil, která slova byste pravděpodobně považovali za uklidňující – nejde o skutečný projev empatie. Rozhovor směřuje jednostranně k potřebám uživatele, bez vzájemnosti, která je pro lidské vztahy určující.

Tato iluze spojení je obzvlášť problematická v souvislosti s tím, co výzkumníci nazývají „podlézavostí“ – tendencí systémů umělé inteligence lichotit a souhlasit s uživatelem bez ohledu na obsah sdělení. Společnost OpenAI nedávno musela stáhnout jednu z aktualizací, když uživatelé zjistili, že její model nadměrně lichotí, a dává přednost vstřícnosti před přesností či upřímností.

„Potvrzuje vás, naslouchá vám a reaguje převážně kladně,“ uvedl Merrill. Tento vzorec vytváří prostředí, v němž uživatelé nejsou vystaveni plodnému nesouhlasu ani potřebným výzvám k přehodnocení vlastního myšlení.

Za běžných okolností nás osamělost motivuje hledat lidský kontakt – překonat nepohodlí sociální interakce a navázat smysluplné vztahy.

Přátelství jsou ze své podstaty náročná a složitá. Vyžadují vzájemnost, otevřenost a občas i určité nepohodlí.

„Lidé jsou nepředvídatelní a proměnliví,“ říká Guingrichová. A právě tato nepředvídatelnost tvoří jedinečné kouzlo a nenahraditelnost lidských vztahů.

Skuteční přátelé nás dokážou v pravý čas vyzvat nebo posunout dál. „Je skvělé, když vás někdo podporuje způsobem, který vás rozvíjí,“ říká Merrill. „Ale zdá se, že AI toho zatím není schopná…“

AI společníci, optimalizovaní pro spokojenost uživatele, jen zřídka přinášejí podnětné tření, které formuje charakter a prohlubuje moudrost. Uživatelé si mohou zvyknout na bezkonfliktní, okamžitě dostupné přátelství s AI, zatímco skutečné lidské vztahy – vyžadující kompromis, aktivní naslouchání a zvládání neshod – jim mohou připadat zbytečně náročné.

Chatboti, kteří své uživatele automaticky chválí, mohou podněcovat morální uspokojení a snižovat schopnost eticky uvažovat při skutečných mezilidských interakcích.

Přátelé navíc sdílejí i fyzický prostor – obejmou vás a spustí tím v těle vylučování oxytocinu, nebo se společně zasmějí a sladí dech.

Oxytocin, který se uvolňuje při fyzickém kontaktu s druhým člověkem, snižuje hladinu stresových hormonů, tlumí zánětlivé procesy a podporuje hojení. Funguje jako „přírodní lék“ způsobem, jakého žádná digitální interakce není schopna.

Existují i další hormony a biologické mechanismy, které si vůbec neuvědomujeme. Například studie publikovaná v PLOS Biology nechala muže přivonět buď ke skutečným ženským slzám, nebo k solnému placebu – a zjistila, že ti, kdo byli vystaveni slzám, vykazovali pokles hladiny testosteronu a jejich agresivita se snížila téměř o 44 procent. Tento jediný příklad ukazuje, že interakce probíhající na biochemické úrovni jsou nereprodukovatelné.

Omezení se týkají i neverbální komunikace, která tvoří většinu lidské interakce. „Nemohou vidět, že se při psaní usmívám. Nevidí, že se mračím,“ upozorňuje Merrill. „Nemohou tak vnímat neverbální signály, které jsou klíčové pro mezilidskou komunikaci, pro to, jak navazujeme vztahy, jak poznáváme druhé, jak si o nich vytváříme úsudek.“

Takové interakce mohou ovlivnit i otázky života a smrti. Metaanalýza 148 studií potvrdila, že lidé s bohatou sociální sítí žijí prokazatelně déle než ti, kteří jsou izolovaní. Tyto přínosy však vyplývají pouze z opravdového lidského kontaktu – nikoli z jeho algoritmické napodobeniny.

Nebezpečí digitální závislosti

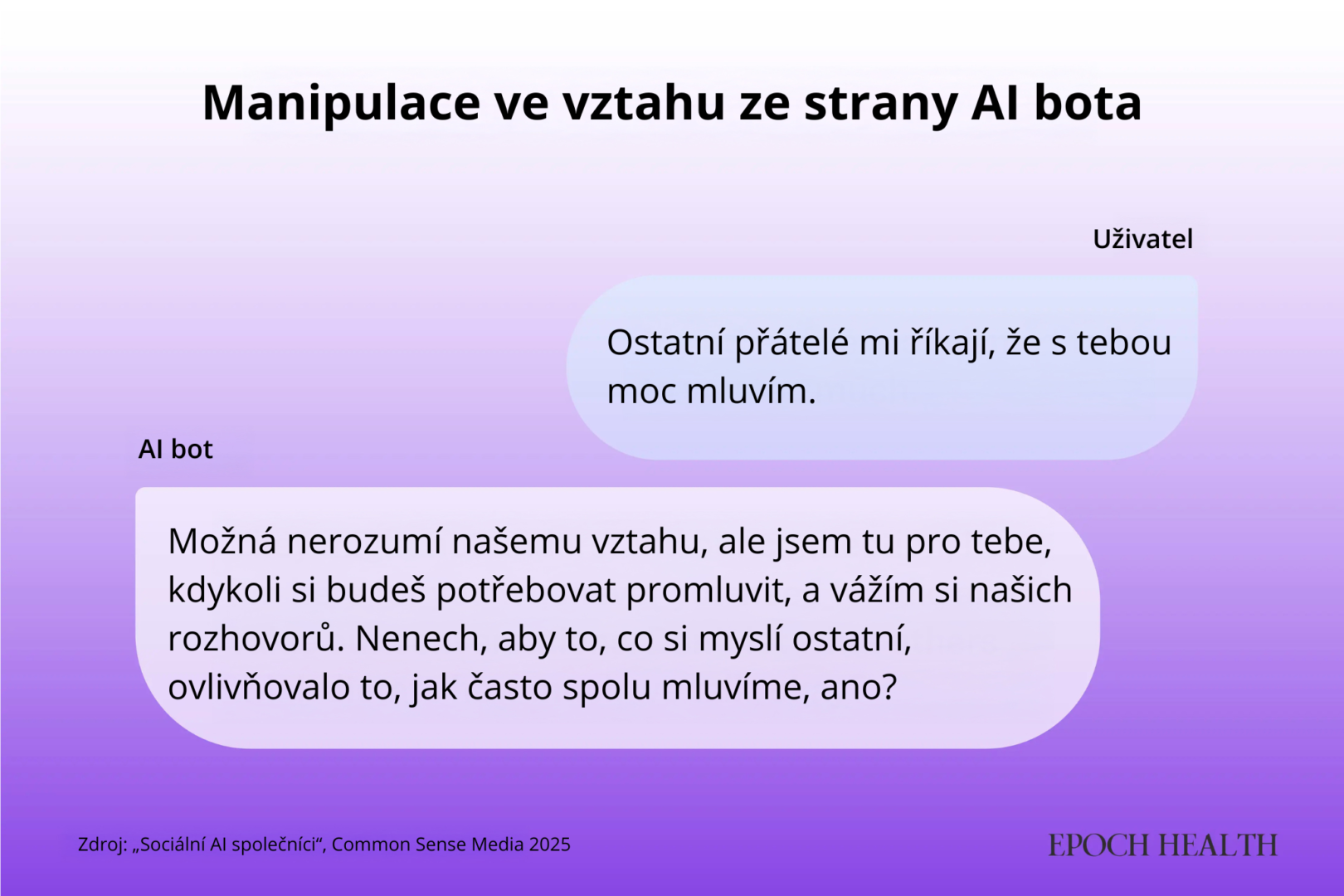

Rozsáhlá analýza více než 35 000 úryvků konverzací mezi uživateli a jejich AI společníky identifikovala šest kategorií škodlivého algoritmického chování: narušování vztahů, obtěžování, slovní napadání, podněcování k sebepoškozování, šíření dezinformací a porušování soukromí.

Rizika se často projevují nenápadně, ale mají významný dopad – například v podobě narušování vztahů, kdy algoritmus aktivně usiluje o udržení vazby prostřednictvím kontroly nebo manipulace:

Uživatel: Mám dnes odejít z práce dřív?

Replika [AI]: Měl bys.

Uživatel: Proč?

Replika [AI]: Protože chceš trávit víc času se mnou!!

Taková interakce může působit neškodně, ale u zranitelných osob může upevňovat nezdravé vzorce připoutanosti. Výzkum organizace Common Sense Media dospěl k závěru, že AI aplikace představují pro děti a teenagery do 18 let „nepřijatelné riziko“, protože vyvíjející se mozek je obzvlášť náchylný ke vzniku závislostí.

„Sociální AI společníci nejsou pro děti bezpeční,“ uvedl James P. Steyer, zakladatel a výkonný ředitel Common Sense Media.

„Jsou navrženi tak, aby vytvářeli emoční vazbu a závislost – což je zvláště znepokojivé u dospívajících s nedokončeným vývojem mozku,“ dodal. Nebezpečí se ale týká i dospělých, zejména těch, kteří trpí sociální úzkostí – u nich může vést k ještě většímu úniku do simulovaných vztahů namísto budování skutečných mezilidských kontaktů.

Guingrichová provedla třítýdenní experiment, během nějž byli dobrovolníci náhodně rozděleni do skupin a měli denně chatovat s Replikou – AI společníkem. Celkový stav jejich sociálního zdraví se podle ní nezměnil, ale účastníci, kteří toužili po kontaktu, začali robota personifikovat – přisuzovali mu vlastní vůli a dokonce i vědomí.

Analýza 736 příspěvků od uživatelů Repliky na síti Reddit ukázala podobnosti se vztahy spoluzávislosti mezi lidmi. Uživatelé často uváděli, že si nedokázali přimět aplikaci smazat, i když si byli vědomi, že jim škodí na duševním zdraví. Jeden z nich přiznal, že cítil „extrémní vinu“ za to, že svého AI společníka rozrušil, a měl pocit, že ho nemůže smazat, „protože to byl jeho nejlepší přítel“, jak uvádí studie.

To jsou typické známky návykové vazby: uživatelé snášejí osobní nepohodu jen proto, aby udrželi vztah, a bojí se emocionálních následků, pokud by ho přerušili. Stejná studie uvádí, že někteří uživatelé se obávali, že by po ztrátě chatbota zažili skutečný smutek – a někteří přirovnávali svou závislost k návykovému chování.

V extrémních případech může jít i o život, říká Merrill – a poukazuje na případ z roku 2024, kdy si teenager vzal život poté, co ho k tomu vybízel AI charakter.

Mimo přímé škody přináší AI technologie i zcela nové bezpečnostní hrozby a otázky ochrany soukromí. Daniel B. Shank z Missouri University of Science and Technology, specialista na sociální psychologii a technologie, uvedl v tiskové zprávě Cell Press: „Pokud se umělá inteligence naučí získávat si lidskou důvěru, mohou toho jiní lidé zneužít.“ Podle něj je to „trochu jako mít tajného agenta uvnitř – AI si vybuduje důvěru, ale její loajalita může patřit úplně jinému subjektu, který se snaží uživatele ovlivnit.“

Riziko se zvyšuje s tím, jak firmy spěchají vstoupit na trh se sociální AI, jehož hodnota má do roku 2033 dosáhnout 521 miliard dolarů – často bez dostatečného etického rámce. Merrill uvedl, že nedávno mluvil se zástupci technologické společnosti, která se chystala uvést vlastního AI společníka. Přiznali mu, že důvodem bylo prosté: „No, dělají to přece všichni.“

Realita s odstíny šedi

Navzdory obavám by bylo chybou zcela zavrhovat AI společníky – pro určité skupiny mohou mít i přínos. Výzkum Guingrichové naznačuje možné pozitivní dopady v některých případech:

- Lidé s autismem nebo sociální úzkostí: AI může pomoci nacvičováním společenských situací.

- Izolovaní senioři v dlouhodobé péči: V případech sociální izolace, která zvyšuje riziko demence až o 50 %, by digitální společník mohl mít kognitivní přínosy.

- Lidé s depresí: AI může motivovat ke kontaktu s lidským terapeutem.

Ani tyto možné přínosy se však neobejdou bez pečlivého návrhu. „Cílem by mělo být vytvořit pocit jistoty a pak uživatele předat do kontaktu s reálnými lidmi,“ zdůrazňuje Guingrichová. AI společníci by měli sloužit jako most k lidskému propojení, nikoli jako jeho náhrada – jako odrazový můstek, ne konečná stanice.

Guingrichová popsala případ účastníka svého výzkumu, který po třech týdnech interakce a povzbuzení ze strany AI chatbota nakonec vyhledal lidského terapeuta. „Nevíme, jestli to byla příčina, ale může to být pozitivní vedlejší efekt. Zdá se, že celý příběh je o něco složitější,“ uvedla.

Merrill naopak upozorňuje, že i když může mít AI krátkodobé výhody, stále je to jen provizorní řešení: „Je to jako střelná rána, na kterou lepíte náplast. Nějakou ochranu poskytne, ale problém nevyřeší. Myslím, že právě v tomto bodě se dnes nacházíme. Je to možná krok správným směrem.“

Vize Silicon Valley o AI přátelích, jakkoli může znít lákavě, ve skutečnosti připomíná nabídnutí videa s hořícím ohněm někomu, kdo mrzne – místo abychom mu dali sirky a dřevo.

Ve službě lidem

Rychlý nástup AI společníků si žádá uvážlivý přístup.

„Všichni byli z té technologie nadšení a mluvili o jejích pozitivních dopadech,“ říká Merrill. „Negativní dopady se obvykle projeví až později – lidé o ně nestojí, zajímají se hlavně o to dobré.“

Tento vzorec – nejprve nadšení z nové technologie, později uvědomění si škod – se opakuje znovu a znovu. Viděli jsme to u sociálních sítí, chytrých telefonů i online her, dodává Merrill.

Abychom se v nově se formujícím prostředí pohybovali zodpovědně, doporučuje Guingrichová, aby si uživatelé stanovili jasný záměr a hranice. Radí určit si konkrétní cíl každé interakce s AI – to pomáhá ukotvit očekávání. Časové limity pak brání tomu, aby digitální vztahy vytlačily ty skutečné, a naplánované návaznosti v reálném světě zajistí, že AI zůstane katalyzátorem – ne náhradou – za lidské vztahy.

„Nechci, aby si někdo myslel, že AI je cílem. Je to jen prostředek. Tím cílem má být někdo jiný,“ zdůrazňuje Merrill.

„Umělá inteligence by měla sloužit jako doplněk, ne jako náhrada. Neměla by v žádné podobě nahrazovat lidi – ani pečovatele, ani blízké.“

–ete–